AI vervangt mensen; wat te doen tegen misbruik?

Kunstmatige intelligentie (AI) is bezig met een onstuimige opmars. Dat levert forse risico’s op voor de samenleving, signaleert de Autoriteit Persoonsgegevens (AP) in haar donderdag verschenen rapport ”Rapportage AI- & Algoritmerisico’s Nederland”.

Wat zijn de grootste risico’s van AI?

Een van de grootste uitdagingen is de stormachtige groei van AI-toepassingen, aldus de Autoriteit Persoonsgegevens. Regulering is daardoor lastig, omdat wetgeving achterloopt op allerlei nieuwe toepassingen.

„AI bepaalt mede de toekomst van kinderen: de doorstroomtoets werkt ook via AI”

Tegelijk zijn de grote techbedrijven verwikkeld in een strijd om hun marktpositie. Ze lanceren nieuwe technologie vaak halsoverkop. De betrouwbaarheid laat daardoor nogal eens te wensen over. Toen OpenAI in 2022 met de AI-chatbot ChatGPT kwam, lanceerde Google in allerijl chatbot Bard, om die na bizarre fouten even snel weer terug te trekken. Momenteel werkt Google aan een zoekmachine met de nieuwe AI-chatbot Gemini. Wereldwijd gebruikt ruim 90 procent van de internetsurfers de zoekmachine van Google.

Hoe raakt de snelle opkomst van AI de samenleving?

AI vervangt mensen; wie kent de chatbots van webwinkels niet? Of neem privacy: in supermarkten hangen AI-gestuurde surveillancecamera’s, evenals in sportscholen, het openbaar vervoer en op straat. AI bepaalt zelfs mede de toekomst van kinderen: de nieuwe doorstroomtoets plaatst kinderen via AI op hun niveau in het voortgezet onderwijs.

Doordat mensen zich vaak niet van de mogelijkheden van AI bewust zijn, staan ze bloot aan misbruik door kwaadwillenden. Stel, iemand krijgt zijn dochter aan de telefoon. Ze heeft geld nodig. De zorgzame ouder maakt het over, maar blijkt te zijn bedot. Aan de andere kant van de lijn heeft een kwaadwillende met AI de stem van de dochter nagebootst, niet van echt te onderscheiden. Of: iemand in Nigeria kan met ChatGPT een taalkundig perfecte tekst opstellen en via een oplichtersmail Nederlandse slachtoffers geld aftroggelen.

Hoe ernstig is dat?

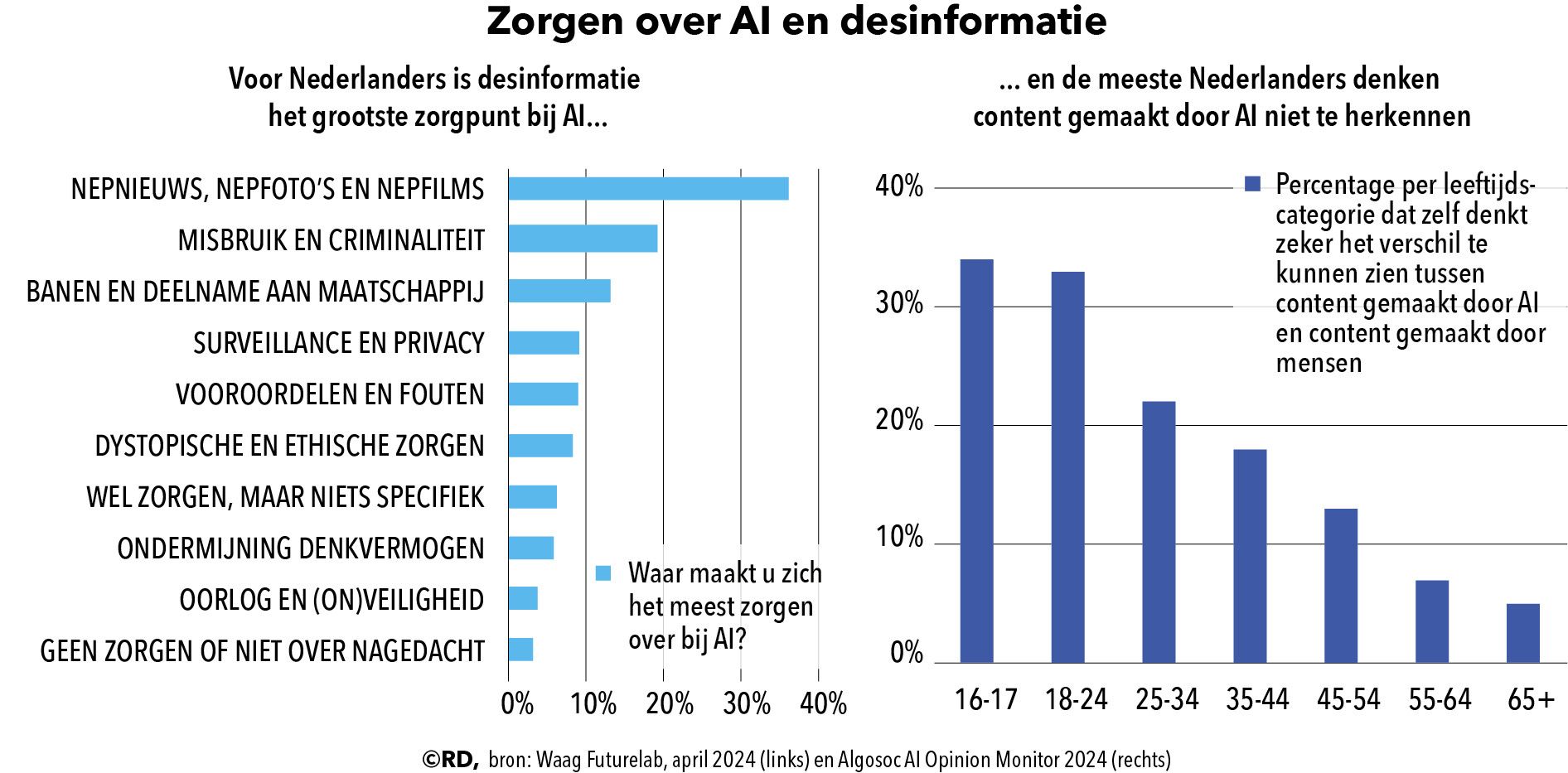

Nepnieuws is nu al een groot probleem op sociale media. Met kunstmatige intelligentie is het nog makkelijker om op grote schaal desinformatie te maken én te verspreiden. Veel meer mensen zullen daarmee te maken krijgen. Ook kunnen kwaadwillenden met AI iemand iets laten zeggen wat hij in werkelijkheid nooit heeft gezegd. Zo ontvingen duizenden Amerikanen een neptelefoontje waarin president Biden zijn partijleden opriep om niet te gaan stemmen. En een werknemer van een multinational maakte ruim 25 miljoen dollar over naar fraudeurs na een videogesprek met zijn vermeende directeur.

„Amerikanen ontvingen een neptelefoontje waarin president Biden zijn partij opriep om niet te gaan stemmen”

Wat kan de overheid tegen dit soort praktijken doen?

Het rapport somt verschillende maatregelen op, zoals wetgeving op Europees niveau, de oprichting van een AI-veiligheidsinstituut dat onafhankelijk onderzoek doet naar AI-systemen en incidenten, de nadruk op zorgvuldig gebruik van AI, investeren in AI-geletterdheid van volksvertegenwoordigers en burgers, en regels stellen waardoor mensen de herkomst van nieuwsberichten kunnen achterhalen.

Moeten we AI niet gewoon verbieden?

Verbieden is geen optie meer; AI is nu eenmaal overal in gebruik. Zorgvuldigheid is echter noodzaak. Bij de toeslagenaffaire vertrouwde de Belastingsdienst te veel op AI en discrimineerde daardoor stelselmatig personen met bepaalde kenmerken. Dat kwam doordat het AI-systeem ervan uitging dat deze mensen vaker zouden frauderen. Met steekproeven zouden dit soort fouten in AI-systemen kunnen worden opgespoord.

Welke maatregelen zijn nog meer mogelijk?

AI-detectietools kunnen AI-teksten herkennen. AI gebruikt vaker dan menselijke schrijvers bepaalde woorden en zinsconstructies. Daarnaast kan het helpen om teksten, beelden en video’s gemaakt door AI automatisch te labelen, waardoor iedereen kan zien dat ze zijn gegenereerd door AI.